国内大模型正处于什么阶段,有关键的技术壁垒吗?

- 3 个点赞 👍

大家发现没,任何一个行业门类的产品啊,技术什么的,中国之外的国外往往只有寥寥几个了,手机,美国只有苹果,韩国只有三星,中国则十个手指头数不过来,华为,荣耀,小米,vivo等等,这还是美国耍孬种才算是给美国保留了苹果,给韩国保留了三星;

汽车正在重演这个格局,这次美国耍孬种意义都不大了。

元宇宙,本次炒作起来这个概念的谷歌,扎克伯格,也都没啥动静了,中国一堆公司仍然在继续群起攻击各个技术门槛,应用场景呢。

大模型,整个地球除了中国,才有几个数得上名号的玩家啊?中国数不过来!

查看全文>>

知乎用户 - 1 个点赞 👍

最关键的技术壁垒,就是只有2个大模型:

国内的优越的社会主义核心价值观的大模型,

国外的无领导无理想一团乱象的大模型。

查看全文>>

居庸炅 - 1 个点赞 👍

百模大战的状态

但百分之90都是套壳垃圾

剩下真正有实力自研的不超过10个

查看全文>>

人类之奴 - 207 个点赞 👍

做大模型的,奉劝大家爬数据要趁早。

之前搜索引擎爬数据,全球大的搜索引擎也没有几家,而且爬数据都是增量的慢慢爬,很少有需要全站重新索引的情况。更重要的是,搜索引擎可是给网站引流的,大多数网站都求着搜索引擎来收录自己的内容。

可训练大模型就不一样了。号称在训练大模型的公司就已经超过了做搜索引擎公司的数量,而且大模型的训练都是争分夺秒,想着一个月就爬遍全网,那产生的请求数量真是非常大。更重要的是,大模型拿走了网站的数据,可不会给网站带来任何流量,反而会把网站的流量吸走。比如一个大模型知道了知乎里面的所有回答,比知乎自己的搜索功能还好用,那原来上知乎的一部分人是不是就跑到那个大模型那里去了?

所以大概没有哪家做内容的网站喜欢把自己的数据送给大模型。

在大模型火之前,网络爬虫的流量就已经占到网站流量的一半左右。如果未来网络爬虫的流量又翻了好几倍,大模型再吸走一些本来属于网站的流量,大型网站一定会想方设法限制爬虫的。

比如搞个内容仅登录可见,就能赶走大多数的爬虫。要想注册大量手机号,每个手机号每天又看不了多少篇文章,这整站爬取的难度就完全不一样了。到时候再想搞到大量优质语料,说不定就只能从数据贩子那里买,这要价不知道要多高。有可能到时候高质量语料直接成为大模型的技术壁垒,新来的玩家除非有钞能力,连训练数据都搞不到。

目前,很多数据中心的 IP 地址段因为爬虫太多,都已经被大型网站风控了。

而且数据中心的 IP 是要钱的,不是想要多少就有多少。假如我想在一个月内爬完知乎,知乎上一共上亿个问题,上十亿个答案,那一天至少要爬几千万个网页,哪怕我有 1000 个固定 IP,一个 IP 一天爬几万个网页也足够被知乎风控了。

所以大家都在用住宅代理,IP 是动态的,大的代理池有上百万个住宅 IP,分散在很多 AS 和 IP 段里面,根本封不完。如果真的走到大多数网站内容注册可见这一步,住宅 IP 就也不管用了。

发布于 2023-09-20 06:52・IP 属地美国查看全文>>

李博杰 - 176 个点赞 👍

查看全文>>

黄翔 - 126 个点赞 👍

Falcon 1800亿参数的大模型出来了。

大模型这项技术壁垒显得不高了。

有技术壁垒的是芯片和稳定的分布式训练基础设施软件。

或许工程经验也有一定的壁垒。

国内应该还没有公司能进行资源利用率30%以上的万卡训练。

只要有足够多的卡和稳定的基础设施,找设计和训练大模型的人才不难。

原因是AI大模型的模型和优化技术太开放了,聪明且自学能力强的人会很快变成专家。

发布于 2023-09-07 17:55・IP 属地新加坡查看全文>>

尤洋 - 80 个点赞 👍

GPT4出来的时候,其他厂商以为OpenAI弄了个诸葛亮,OpenAI也暗示自己是诸葛亮,所以大家都以为被降维打击了,都在朝着虚假的目标努力。

但是,上个月黑客大神George Hotz曝光chatgpt其实是由8个MoE模型组成,而互联网知名撰稿人Dylan Patel则表示是由16个MoE模型组成。

George Hotz:任何人只要付出一样的成本,都可以复现chatgpt;

Dylan Patel:Google,Meta,Anthropic,Inflection,Character,Tencent,ByteDance,Baidu等都可能拥有与GPT-4一样强大的模型。OpenAI的解决方案不是魔法,而是可以复现的。

当人们发现其实是8(16)个皮匠后,人工智能又变成了有多少人工就有多少智能,所谓技术壁垒也就不存在了。

编辑于 2023-07-17 23:39・IP 属地山东查看全文>>

ZOZO - 52 个点赞 👍

我觉得最大的技术壁垒,还是定位不同

显然openai的目标是超级智能体,简单人类任务搞定了,向着人类心智的荣耀数学,开始发起冲锋。

国内大模型的目标是垂类/行业/场景“大模型”,依然是短视的商业逻辑。这些都不是真正的大模型,至少和openai 的目标AGI相去甚远

所以不出意外,过几年,国内还会被国外大模型震撼一波

发布于 2023-08-20 23:51・IP 属地广东查看全文>>

小金金 - 20 个点赞 👍

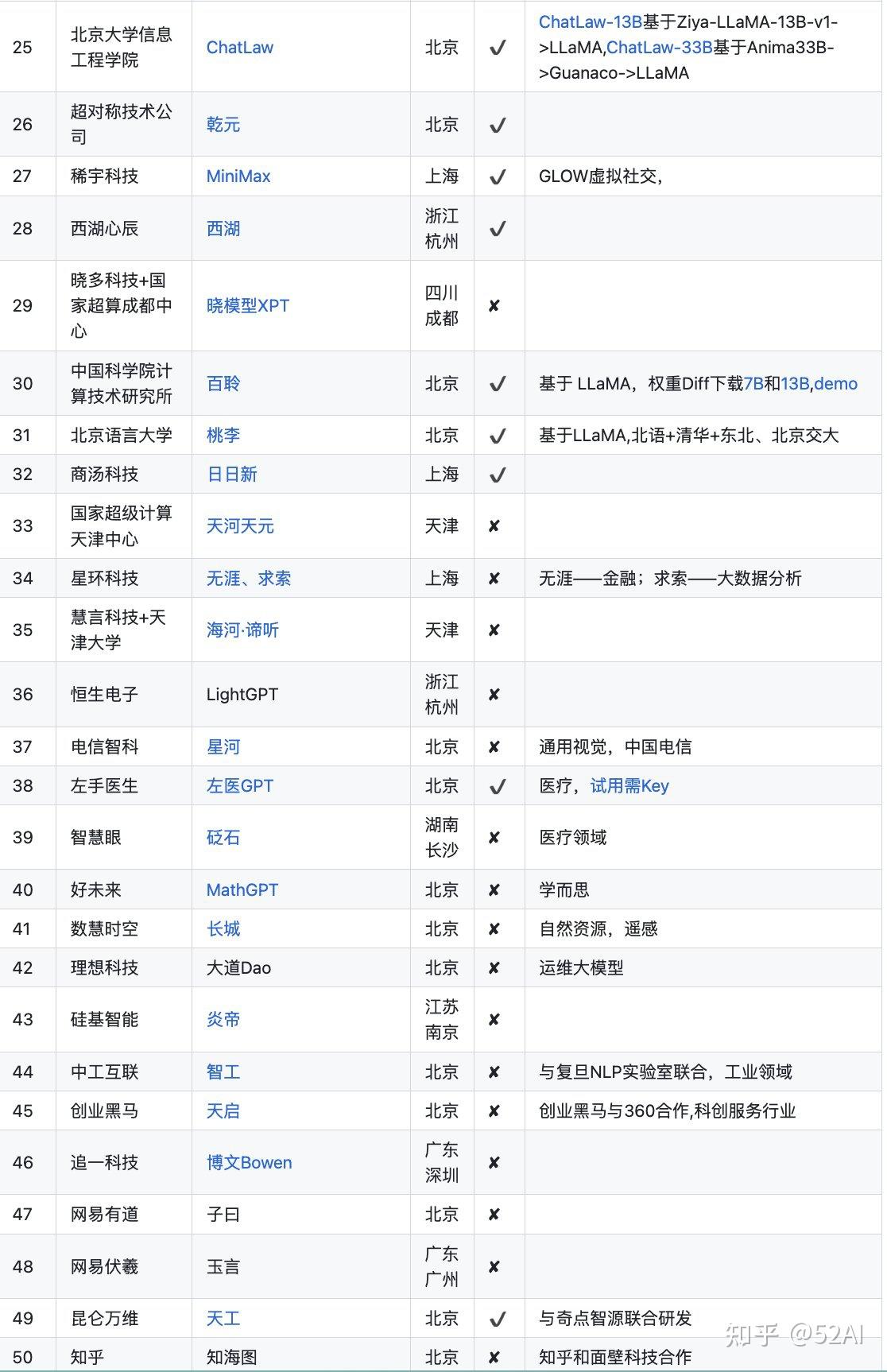

以国内大语言模型为例,先看下国内LLM的进展。下图的103个大模型说明有点资金和技术实力的公司,学术机构都直接或间接研发了LLM,该入场的都入场了。

不到半年的时间,就如此这般。说明技术上没啥壁垒,真正的壁垒来自数据。 目前该进入拉开性能差距,吸引留住更多用户的阶段。

中国大模型列表: https://github.com/wgwang/LLMs-In-China

更新下,数据来源中国大模型列表

编辑于 2023-07-18 10:18・IP 属地北京查看全文>>

52AI - 15 个点赞 👍

实话说,在开源的模式下,当前大模型技术领域普遍缺乏显著的技术壁垒。国内大模型虽然没有处于领先阶段,但是也没有太掉队。

国内大模型的现状

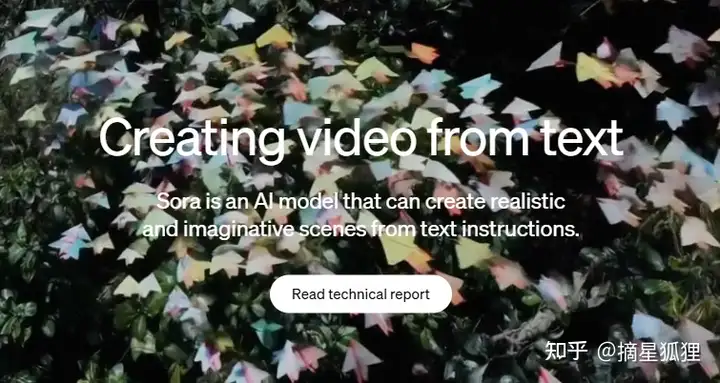

大模型的核心本身不是什么秘密,作为研究成果都是公开的,各大模型也是在这套核心上基于各自的技术理解和取向走了对应的实现之路。比如chatgpt的通用模型、sora的文本生成视频模型。

而Sora至今只完成了公测版本还没有完全开放,反而是国内的可灵优先上线。

今年的7月份,openAI的API不对中国开放,国内很多借助API开发的AI公司面临灭顶之灾。但是,在此消息之后,国内很多大模型平台,比如阿里云百炼(Qwen2-72B)、智谱(GLM-4)、文心旗舰模型(ERNIE Speed/ERNIE Lite)等都为OpenAI API用户提供使用国内大模型的替代方案。这也侧面表现出我们国内大模型的能力还是不弱的。

另外,在国外优秀的ChatGPT-4、Claude3.5等大模型的引领下,国内的大模型借鉴国外的成功经验,有清晰的问题和目标,反而拥有一定的后发优势。

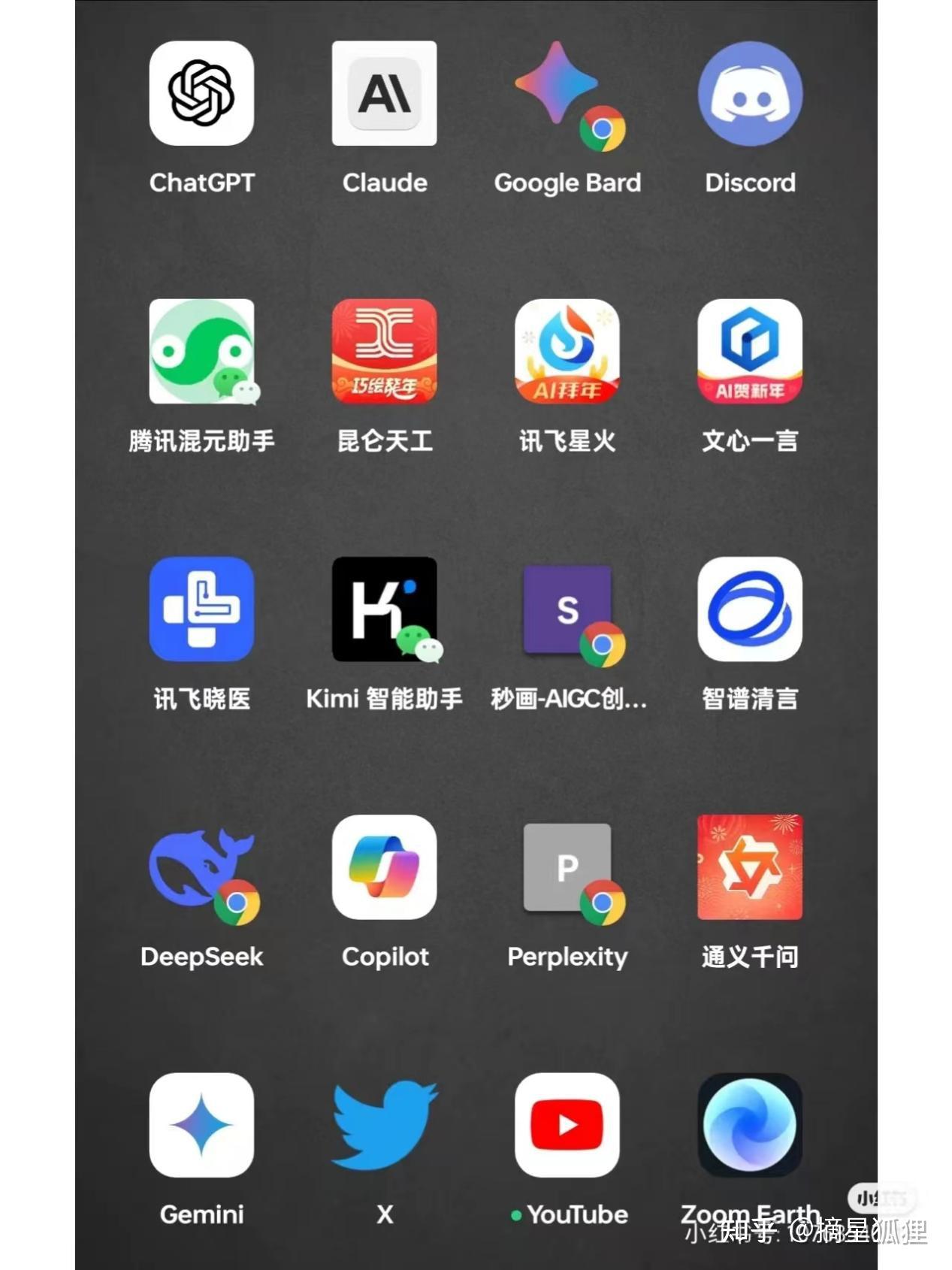

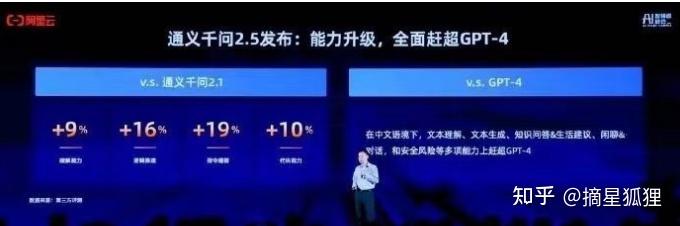

通过个人使用体验来讲,国产大模型中整体最有的是阿里的通义千问,拥有最强算例,通过其开源的方式,吸引了大量开发者,形成了一个活跃的生态系统。

从专项能力看,对长文本支持最好的是月之暗面的kimi,可以解读上百万的文字,并且任意提问、总结等操作

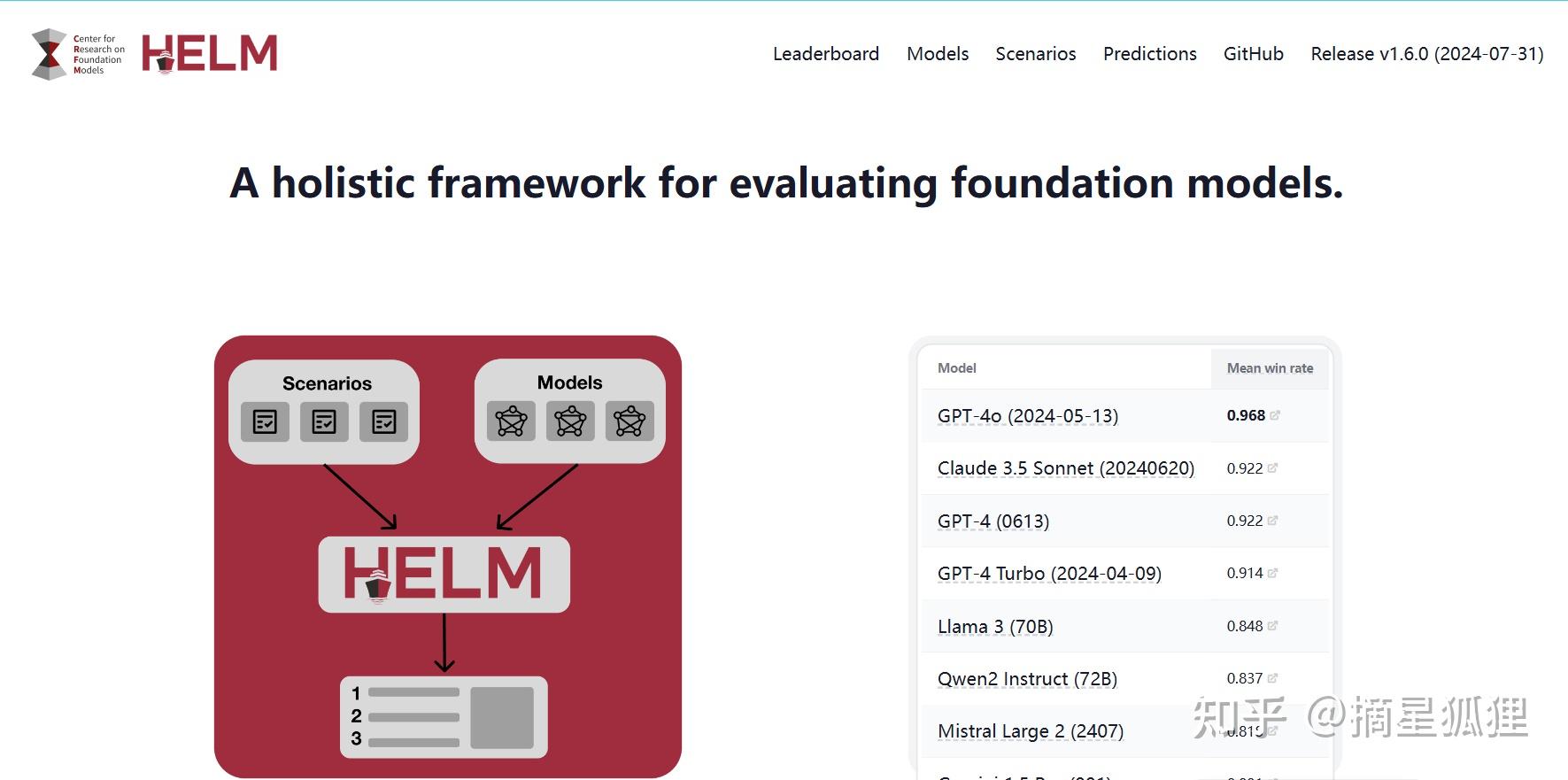

通过斯坦福大学基础模型研究中心近期公布的HELM MMLU大模型评估排行榜最新一期显示,阿里巴巴集团旗下的Qwen2 Instruct(72B版本)就占据了前十的位置。

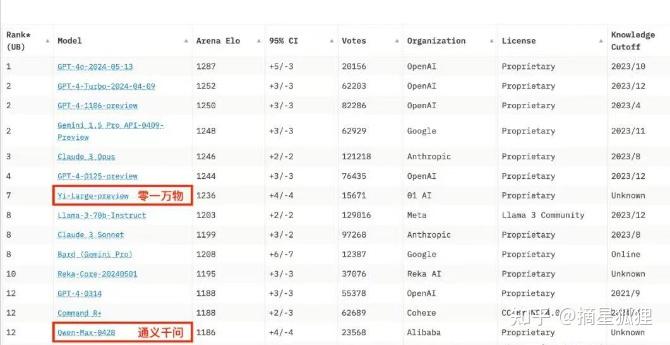

而且,零一万物(Yi-Large)大模型,在LYMSY发布的chatbot Arena榜单中取得了世界第七、中国第一的成绩,排名超过了通义千问。

而且,国内更注重垂直行业与领域大模型的落地应用。《互联网周刊》上发布“大模型活力TOP150排行榜”,应用于工业领域的华为的盘古模型就位列第一。

而国外则在算法创新、通用大模型、多模态互动方面优势明显。

但是,和顶级模型如ChatGPT和Claude相比,在我看来,还是在逻辑、理解和内容表达上,还是存在差距的。

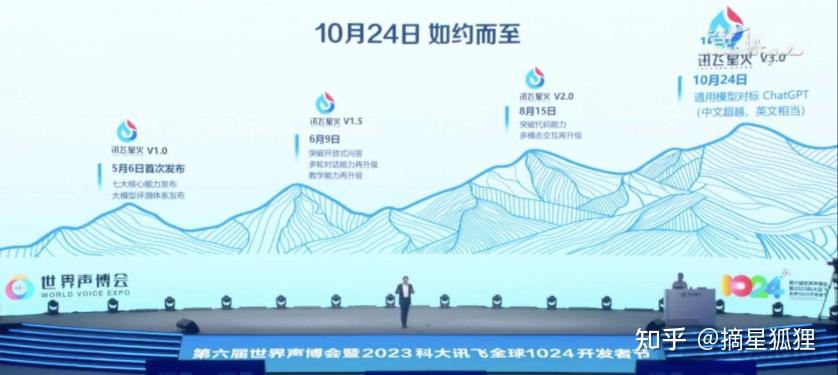

比如,就像科大讯飞的星火大模型在多模态能力上就比较弱势。

不过,我们由于语言的差别,国内的通义千问对于中文的识别和表达明显优于国外的一些大模型。

可见,目前看来,国内的大模型至少没处于太掉队的状态。从大模型的发展历程和未来的发展趋势来看,现在正是加入这个行业的绝佳时机。随着国内大模型技术的不断提升和逐步落地,特别是在垂直行业和领域的应用场景中,市场对大模型的需求日益增长。

尽管行业竞争激烈,但正因为技术的开放性和发展迅速,进入这个领域的门槛相对较低,即使你没有太多的行业经验,现在进入AI这个风口行业也不会太晚。通过参与专业的学习课程,你可以快速掌握核心技术,并明确未来的职业发展方向。

因此我非常推荐知乎知学堂的AI免费课程,通过行业大佬们的讲解,来更清晰的认知国内外大模型的能力,想清楚自己该如何增收。而且,课程还有专门的助教老师,添加即可获得一对一解惑指导,现在点下方链接报名只要0.1元。

🔥2024大模型公开课👉技术原理+模型训练+应用场景¥0.00点击领取这个免费课里,我还学到了大模型微调、LangChain开发框架的用法等AI解决业务问题的核心方法、培养独立开发AI产品的能力,还能拓宽技术视野,构筑核心竞争力。

国内大模型的下一步发展趋势是什么?

AI的三大版图:充足的算力、优质的训练数据、优秀的算法。在百模大战,百家争鸣的市场竞争中,我们从数量到质量的发展,越来越清晰国内大模型想做到弯道超车,就要抓住我们的优势,努力发展大模型垂直领域的应用。

因为通用大模型离我们还是有段距离的,比如训练成本贵,技术积累还是不如目前闭源的chatgpt-4。

但是,我国有成熟的互联网大数据体系和大数据潜力,非常擅长通过具体应用场景推动算法迭代升级,在各个特定领域建立算法优势,比如kimi就是读取上百万字的长文本。人们需要的也是能帮助我们实实在在解决问题的项目。

SuperCLUE团队今年4月发布的《中文大模型基准测评2024年4月报告》也表现出了我们的大模型在垂直领域的大量落地实现。

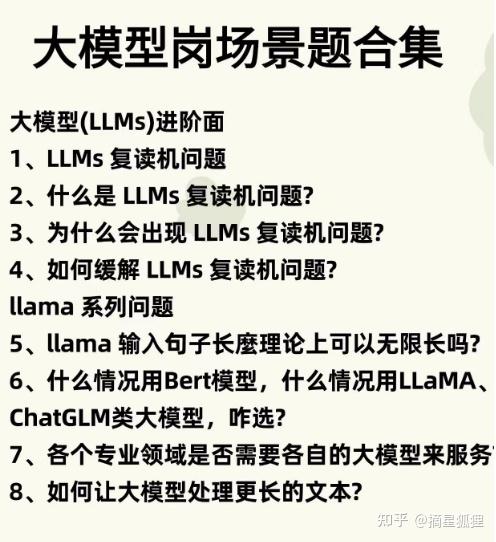

另外,跟着大公司的招聘风向,我们也能更加确定,专业领域的大模型服务是他们未来需求的重点,大企业在面试的时候也更关注应用落地。

技能训练和职业发展

找准出路之后,我们能做的就是努力提升自己的实力。

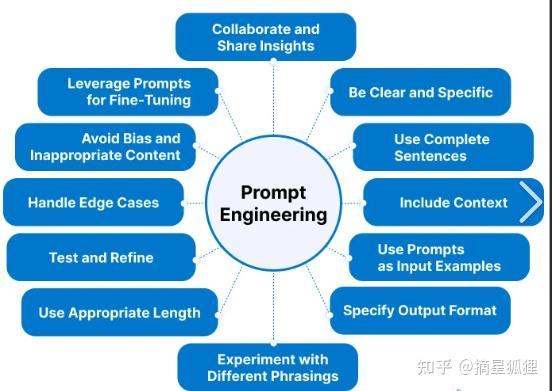

其中Prompt Engineering个人觉得是所有LLM相关程序员必须掌握的技能,而且上手成本不高。Prompt Engineering就是讨论如何有效的与人工智能进行交流,通过对Prompt进行设计、优化调整,使得LLM生成更准确生动的自然语言文本。比如可以用在问答、翻译、摘要生成等方面。并且,如果你选择的LLM是国内的,那么prompt编写最好用中文,因为如果你不用对应的语言写prompt,那么会有一定概率出现输出语言错误。

课程中还会学习LangChain+Fine-tune来实现模型定制化。这些技术都是由行业大佬讲解,让你不走弯路。并且大佬们还认真和你探讨借助大模型技术提高收入的可能性。

而这些技术的精进只需要你有基础的程序代码或者python的基础就可以。

虽然,目前有一部分人唱衰LangChain,觉得它框架不灵活并且抽象。LangChian的抽象不仅增加了代码的复杂性,而且每个组件都需要深入理解才能避免意外崩溃。另外,学习成本高,很多人花大量时间去学习,还学不会,甚至框架还限制了程序员的灵活性和创新能力。比如,只是走request请求方式,可能直接编写代码比适应LangChain的解决方案更为直接和有效。

但是,我还是建议该学还是去学,学习成本虽然高,但是人家文档写的好,比如document splitter。如果花时间点进代码看具体的chain和agent实现之后,自己写真的非常省时间。而且,其组件丰富,易集成性,都是很好的优势。

有入职字节、腾讯、阿里大模型的小伙伴,也分享到面试中很重要的一部分内容就是关于LangChian的。所以,这个技能还是很有需求的。

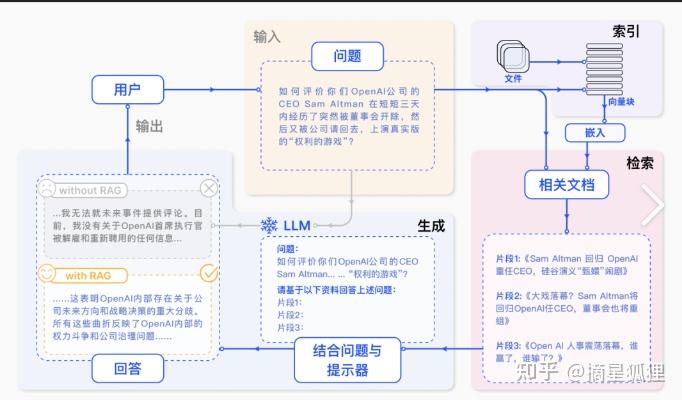

大模型技术架构从纯Prompt的简单对话,到Agent+Function Calling的主动交互,再到RAG的高效检索,最终到Fine-Tuning的深入学习,每一种都有其独特的优势和应用场景。

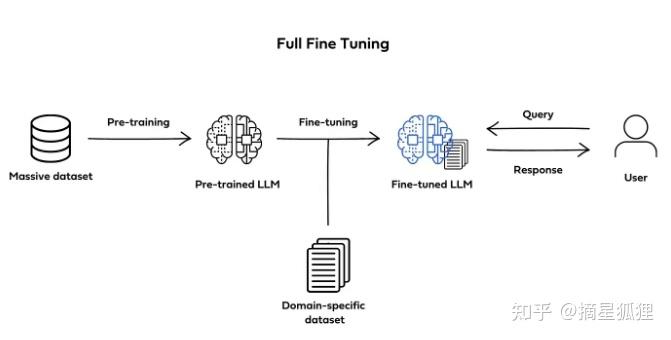

目前,构建企业垂直场景大模型应用的时候,涉及到两个最重要的核技术选择,检索增强生成(RAG)和模型精调(Fine-Tuning)。

Fine-Tuning通过对特定任务和领域的进一步训练,就可以让其在特定领域表现得更专业,比如医学诊断、自动驾驶等等。

目前,有个体验用户讲到,chatgpt的Fine-Tuning仅仅训练一下,数据集的数量级在千条不到,就需要10刀,真的是很贵。但是,某种程度上来讲,对于小项目的垂类GPT3.5的生成非常有帮助,并且性价比高。

这里就不得再次感谢知乎知学堂上提供的免费课程。通过这门课程,了解大模型时代程序员必备的技巧,以及如何使用技术,从而更好的提升自己,抓住赚钱的机会。而且,有免费的Fine-tuning训练模型,快来体验吧。

🔥2024大模型公开课👉技术原理+模型训练+应用场景¥0.00点击领取未来,大模型的发展还是以商业化为主,谁更会用大模型,训练的更有用,更好的做到落地,就能做到行业的前端,我相信,未来很长一段时间,市场肯定需要大量相关的技术人才,赶紧行动起来吧。

发布于 2024-08-22 14:26・IP 属地北京查看全文>>

摘星狐狸 - 6 个点赞 👍

查看全文>>

朱翔宇 - 2 个点赞 👍

一开始以为训练大模型需要更多数据,国内搜索的扛把子会搞出一个特别牛逼的模型,惊艳到所有人。

结果发现并没有那么牛逼,甚至分不清计算机的总线和公交车,更有松鼠鳜鱼,夫妻肺片等贻笑大方的杰作。

后来才知道,按现在的训练方式,到了一定数量级,质的比重是大于量的。优质比多更好。大模型训练出来的是记忆力超强的天才,在模型会学学习之后,让他重复学习参差不齐的东西就有点浪费了。应该给他他能懂,但是还没见到的东西。

因此,现在的瓶颈很有可能是国内互联网各自为战,各自闭环导致大模型不够全。有些大模型天天刷知乎,有些大模型天天看公众号,有些大模型也只能天天逛贴吧。

编辑于 2023-07-18 14:34・IP 属地北京真诚赞赏,手留余香还没有人赞赏,快来当第一个赞赏的人吧!

编辑于 2023-07-18 14:34・IP 属地北京真诚赞赏,手留余香还没有人赞赏,快来当第一个赞赏的人吧!查看全文>>

来自星星的我 - 2 个点赞 👍

没技术壁垒,唯一壁垒在数据。

只根据chatgpt/gpt4个别例子很厉害,或者做某些科目的题目很厉害,就认为通用人工智能就要来了,或者已经找到了通向通用人工智能的路,肯定是太乐观了。

当前的大模型,我觉得并不算到了质变,和GPT1,2,3没有本质区别。当时这些模型在很多任务上性能也是大幅超过之前的模型,也引来国内纷纷模仿。

自从有了CLUE榜单,大家各种刷,比如21年盘古大模型,2000亿参数,发布会show起来各种对话流畅的很。百度发布文心大模型,各种刷榜第一名。腾讯就多了,包括腾讯云的神农,TI-NLP,QQ浏览器的神舟, 摩天,TEG的混元。

当时宣传点,一是登录CLUE第一名,后面宣传开始说首个超过人类水平(human baseline)的模型。二是比谁参数量大,从几亿,几十亿,百亿,盘古2000亿。

这些模型真正超过人类了吗?显然没有,不仅没有,这些大模型连落地的都没有。

这么玩下去,也不行啊,当时很多做大模型的团队后面都转做别的了。

还没消停一年,chatgpt来了。一帮外行开始叫嚣通用人工智能要来了,各种chatgpt的惊艳回答开始刺激大家神经,很多看上去很专业的人也开始鼓吹AGI。

实际在我看来,这些所谓的很智能回答就是魔术,现在的数据,还不足以训练出来很智能的模型。强化学习只是看上去很美好,实际执行起来比较难。

编辑于 2023-07-18 16:49・IP 属地上海查看全文>>

紫竹 - 2 个点赞 👍

个人认为,LLM处于当年ResNet阶段,由transformer堆叠的decoder架构,亦如CNN堆叠的ResNet,效果上都有巨大的提升,是里程碑的技术和事件,离产业落地还有一段距离,CNN后续也持续的改进比如SepConv,然后才有mobilenet系列,这是可以大规模落地的方法。

未来一段时间,肯定有一批对transformer的改进,不排除会出现Mobile LLM这样的架构,如果全球最聪明的人和最有钱的全部参与进去,进化速度更快。

当年的学生做实验想办法搞一张卡,现在学生做实验得搞几张A100,穷人都一样的难,A股一样的稳。你看看各大云平台还有A100可租吗?3090都难。

预测一下,明年两会会正式提出AI+战略,亦如当年的互联网+。

编辑于 2023-07-19 22:11・IP 属地广东查看全文>>

平行宇宙 - 0 个点赞 👍

仍然处于算法优化工作创造的实际价值不如UI设计阶段

与国内半导体行业初期一样,融资充裕,导致很多厂商不用认真搞研发,推几个半成品甚至更差的产品就说自己是这个概念的

多数产品没什么人在用,只有投资人在用

这种情形,基本上是五年前的半导体,半导体我们发展了五年,虽然有进展,但可能后期突破后来看,这速度就是国际平均水平,赶超也是较难,大范围投资只能到够用水平,但我们不是纯粹的资本过剩,过度集中发展导致其他行业错过很多机会

国内大模型这个产业,你的模型随便copy一个项目,套壳,闭源,毕竟文心一言都是录视频展播,有这个TOP1作为先例,还能更差吗

所以我认为,现阶段决定大模型拿到融资高低的,是UI,最能给企业带来价值的,是UI

商业化残酷一点,现阶段你搞点融资活下去,再过几个月GPT4架构等等具体信息都被黑客搞出来,少走很多弯路也少花投资者很多钱

发布于 2023-07-18 00:04・IP 属地吉林查看全文>>

红旗漫 - 0 个点赞 👍

什么阶段?群模乱舞的阶段。自3月至今,推出所谓自主研发的国内LLM大模型估计得上百家。这还是叫的出名字的。

关键的技术壁垒?国内模型,目前看没有。

讲个真事,4月份推出的最火国内LLM,chatglm-6b,商业报价300万,chatglm-130b商业报价2000万。6月推出的第二代chatglm2-6b就免费了。为啥?被后面的免费商用baichuan-7b超过了。你说这能有啥门槛?啥技术壁垒都没有。

其实不光国内,老美那边也差不多。自从GPT3以后,openai就玩封闭不介绍不开源了。当然事实上搞得抄作业团体很郁闷,但老美那边也有人不服自己干,比如马斯克,还有黑客爆料,说GPT4是8个**组合的。

目前业内一致公认的就是,transformer架构确实有效,大力能出奇迹。所以AI三要素,算力,算法模型,数据,老美制裁咱啥?就是算力,不给你高端GPU,会制裁你模型数据吗?不会,那属于吃力不讨好。

国产GPU目前在快马加鞭搞,反正AI所需GPU的基础技术都是很明确的,抄作业nvidia就好,只是不知道国内能不能搞出自己的CUDA。

从热度上,LLM大模型正在降温,从CSDN的相关大模型发帖就能看出。

怎么评判一个大模型的好坏?最简单的就是能复现,通过Github读官方文档能顺利clone并用本地知识库微调,目前这方面国内还很欠缺。

发布于 2023-07-18 04:10・IP 属地上海查看全文>>

机器比人简单 - 0 个点赞 👍

大众以为的大模型,高深的算法;实际上数据+算力

在大模型出来之前,各大厂也在用算法,为啥这次会有这么大的市场热度?

以前大众感知是抖音推好玩的内容,淘宝推喜欢商品,百度能搜到内容等等

这次大模型主要在多模态生成式AI上,普通用户更直观的感受,我问一个问题,他不是从原有的纯文本/商品/视频给我找出来,而是基于问题混合打包且创造(生成式AI无中生有)回答问题

但不管怎么搞,算法模型上并不是竞争壁垒,很多开源、论文都可以研究,但是数据是非常私有,比如抖音天然内容、用户标签,淘宝想做内容,哪怕算法模型一致,但是从数据积累上就不在一个维度。

同理做生成式AI的前提,是算法能理解用户问的是啥,每个语料是个啥,细分到每个垂类行业经验是啥,这些都依赖人工数据经验的梳理和标注,告诉算法什么是对什么是错。且按照大模型的置信度,很难做到百分百,目前市场爆发点是写小说、写市场营销文案、绘画等这些数据集相对简单容易学习的方向,但再垂类一些市场,比如语音对话、母婴经验、心理咨询师各类虚拟专家,需要更垂的语料。所以短期市场的壁垒是数据

另外,因为大模型数十亿参数,每一次迭代模型都是几千万的费用,哪怕是大公司也没办法高频迭代模型,所以算力提升也是当前非常非常重要优化方向,以目前全球范围来看,谁先突破算力,多迭代几次模型,谁知道会产出个啥

说不定我们都在黑客帝国

编辑于 2023-07-18 04:00・IP 属地浙江查看全文>>

三木 - 0 个点赞 👍

查看全文>>

烧饼馒头包子麻花 - 0 个点赞 👍

查看全文>>

安铁皮不安好心 - 0 个点赞 👍

简单来说,技术壁垒,是国力。

国力足够强,能暴力穷举到解决问题的,是最终的赢家。

美国从冷战开始后搞DARPA,搞军民融合,搞国防项目商业化招标,优中选优,就是用的这个思路。

我发动全民力量,多角度暴力穷举,然后用人民真实的选择来决定一种思路的正确与否。

那苏联为什么在冷战狂攀科技的比拼中失败呢?

因为他们没有足够庞大的相关人员参与到多种“解题方案”的筛选中,也没有足够的市场进行“试错”,这就导致在80年代,苏联的航天等许多高科技领域已经被美国甩开了一大截子,被人拉开了生产力的差距。

前车之鉴在此,我要说什么大家肯定都能理解了。

关于这一块,只有拥有足够庞大的数据可供智能学习,拥有足够多的相关从业人才不断试错,拥有足够多支线技术道路不断探索,拥有足够庞大的市场能够给予正向反馈的那个国家,才能笑到最后。

发布于 2023-07-18 00:20・IP 属地北京真诚赞赏,手留余香还没有人赞赏,快来当第一个赞赏的人吧!查看全文>>

李渤瀚 - 0 个点赞 👍

分布式训练方法:大模型训练技术有更复杂的分布式训练方法,可能一张卡才能塞下一层;

数据:数据量,数值质量,数据清洗;

学习方法:多模态结构、强化学习、自主进化学习等;

计算资源:训练集群环境搭建;

后期的部署测试。

发布于 2023-07-18 10:53・IP 属地上海查看全文>>

xiansheng - 0 个点赞 👍

查看全文>>

南山 - 0 个点赞 👍

所有的AI,壁垒都不是算法,而是体力工作——整理和标注训练素材。

当然了,很多领域的壁垒更靠前,获得训练素材就是壁垒。

所以这事跟锗和镓的生产难点是接近的。

要么你可以不惜代价,用100块钱干别人1毛钱就能做好的事。

要么你必须有完整的周边产业链,能够低成本地获得某些海量的训练数据。

要么你有海量廉价劳动力,能用较低成本去人肉标定、清洗训练数据。

AI画图的发展,来自于pixiv等网站上画手免费公开的图。

AI对话的发展,来自于搜索引擎抓取的大量知识性网站的信息积累。

大模型翻译,很可能依赖于之前像新东方等教育机构整理的翻译训练的素材,以及大量的网友纠错。(这块我有几年没接触了,不太清楚最新的玩法是啥)

这些体力劳动,才是壁垒。人力、资金、法律都会形成阻碍。

中国目前进展最领先的领域之一,肯定是推荐系统。

另一个是类似于无人机等智能硬件上用得到的技术。

像画图、聊天等纯娱乐领域,进展肯定会非常慢。因为这块明摆着没啥商业收入。

无人驾驶,现在也遇到了训练素材阻碍的问题。

简单讲,这事是需要低人权优势的。

哪国的法律、伦理比较没下限,敢像特斯拉那样让大家敞开用、敞开死,哪国的进展就会更快。

中国在这方面,其实是吃亏的,估计只有军用才有可能带来场景上的突破。

发布于 2023-07-18 12:53・IP 属地湖南查看全文>>

Sental Cristar - 0 个点赞 👍

查看全文>>

画天涯 - 0 个点赞 👍

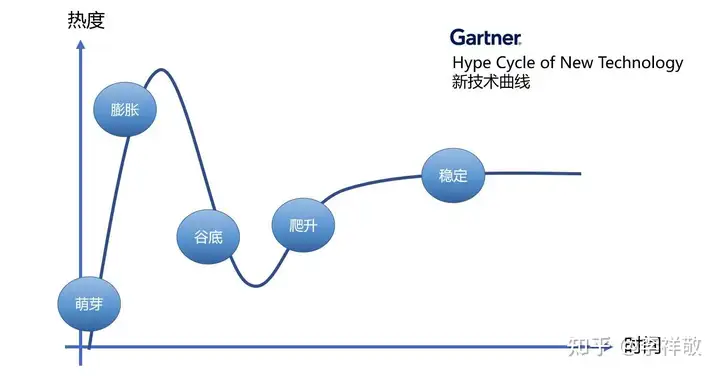

就像互联网时代和手机市场,国内的大模型市场还处于初期阶段,处于曲线的起步阶段。

技术曲线 大模型PK的是算力、算法、模型,算力可以采用堆砌的暴力方式解决,但是模型就需要拼实力了,数据也是。这三个要素对于国内来说都是不可越过的门槛。

发布于 2023-07-18 14:36・IP 属地北京真诚赞赏,手留余香还没有人赞赏,快来当第一个赞赏的人吧!查看全文>>

李祥敬 - 0 个点赞 👍

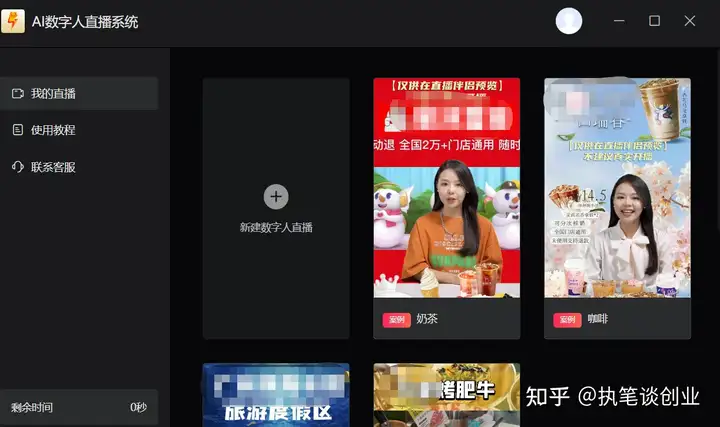

国内大模型目前正处于快速发展的阶段,取得了一系列重要的突破和进展。在这个领域,存在一些关键的技术壁垒,但同时也有许多优点可以推动其发展。本文将以数字人直播为例,详细介绍大模型的优点,并探讨相关的技术壁垒。

数字人直播是一种利用大模型技术实现的虚拟主播形式,通过对真实主播的数据进行采集和分析,生成一个虚拟的人物形象,并通过计算机程序实现其自动化的表演和互动。数字人直播具有以下几个优点:

首先,数字人直播具有高度的可定制性。通过大模型技术,可以根据用户的需求和喜好,定制出不同风格、不同特点的虚拟主播。这些虚拟主播可以具备不同的外貌、声音、性格等特征,满足用户对于多样化的需求。

其次,数字人直播具有高度的可扩展性。传统的主播需要人工参与,而数字人直播可以通过大模型技术实现自动化的表演和互动。这意味着可以同时推出多个虚拟主播,满足更多用户的需求,而不受时间和空间的限制。

再次,数字人直播具有高度的可控性。通过大模型技术,可以对虚拟主播的行为和表现进行精确的控制。这意味着可以实现更加精准的互动和表演,提供更好的用户体验。

此外,数字人直播还具有高度的可持续性。传统的主播需要不断休息和调整状态,而数字人直播可以实现24小时不间断的表演和互动。这意味着可以提供更加稳定和持续的服务,满足用户的需求。

然而,国内大模型在实现数字人直播等应用时仍面临一些关键的技术壁垒。首先,大模型的训练需要大量的计算资源和数据支持。目前,国内在计算资源和数据方面还存在一定的短板,这限制了大模型的发展和应用。

其次,大模型的训练和优化需要高水平的人才支持。目前,国内在大模型领域的专业人才相对不足,这导致了技术研发和应用的进展相对缓慢。

此外,大模型的应用还面临一些法律和伦理问题。例如,数字人直播涉及到虚拟人物的形象和声音,可能引发知识产权和隐私保护等问题。这需要相关法律法规的完善和技术的创新,以确保大模型的应用能够合法、合规地进行。

综上所述,国内大模型正处于快速发展的阶段,数字人直播作为其应用之一具有许多优点。然而,大模型的发展仍面临一些关键的技术壁垒,需要进一步加强计算资源和数据支持,培养更多的专业人才,并解决法律和伦理问题。相信随着技术的不断进步和创新,大模型将在未来发展出更多的应用,为用户带来更好的体验和服务。

发布于 2023-07-18 21:52・IP 属地广东查看全文>>

执笔谈创业 - 0 个点赞 👍

弄出芯片这种东西可以有技术壁垒,弄出牛顿三定律这种东西还要个锤子技术壁垒。当然人们对LLM到底是哪个级别的突破还在吵个不停,但人家做出GPT的这帮人早就奔着下一个阶段去了。

发布于 2023-07-19 02:08・IP 属地加拿大查看全文>>

ELPSYCONGROO - 0 个点赞 👍

我不懂国内大模型发展到什么程度了,但提出自己使用GPT的看法:基于GPT过于聪明,有时难以相信它的答案,因为它有时是会胡编乱造的,以至于我不敢相信它。只能有时一些文章会交给它,但涉及到专业的,都不会交给它。甚至一些普通的搜查对话,我也抱着怀疑的态度。

发布于 2023-07-19 07:28・IP 属地广东查看全文>>

爱吃零食指点江山 - 0 个点赞 👍

ChatGPT访问不方便,老有读者问有没有平替的国产大模型推荐,国内做大模型的团队超过百个,但客观说,国内这些同行跟ChatGPT3.5还有存在明显差距,更不用说最新的4.0。大模型是个硬骨头,钱人缺一不可,国内真能搞大模型的技术人才十分稀缺,王慧文都抑郁了,据说跟找不到一流的技术人才有关。总的来说,大家对国内大模型要有耐心,他们需要时间打磨。

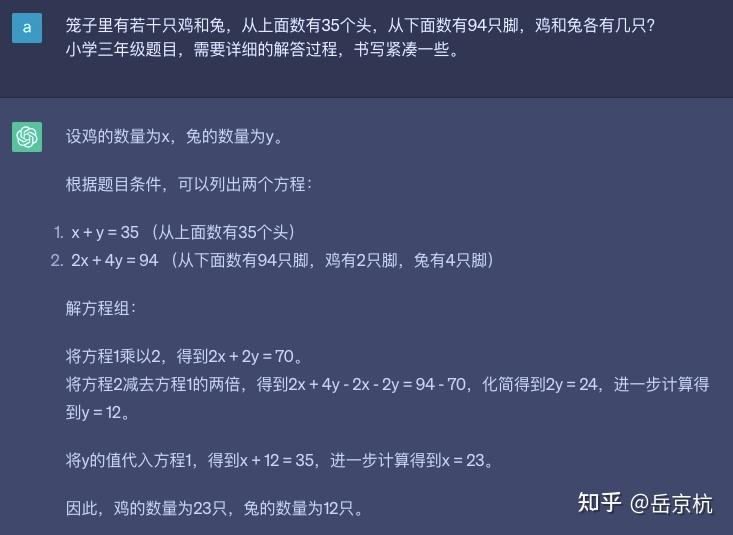

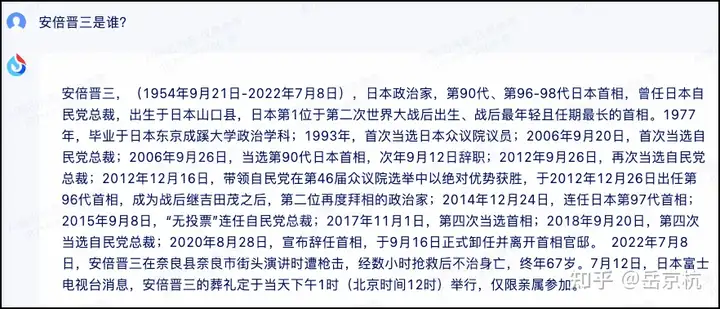

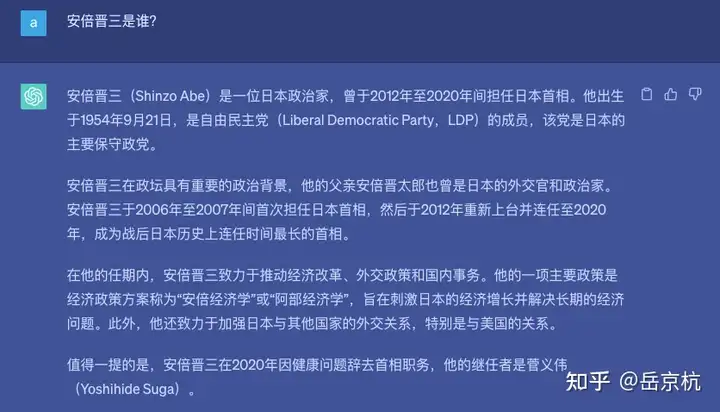

我一共体验过三个国内的大模型产品,分别是百度的文心一言,清华大学的ChatGLM、科大讯飞的讯飞星火,这三都是国内的佼佼者。讯飞星火是这两天体验的,挑几个问题给大家展示一下:问题1:安倍晋三是谁?

讯飞星火

ChatGPT3.5 讯飞星火的回答比GPT3.5更准确,他知道安倍已经遇害,而GPT3.5不知道,因为GPT3.5的语料库截止2021年9月份,之后发生的事情他都不知道,讯飞星火的语料库比GPT3.5新。

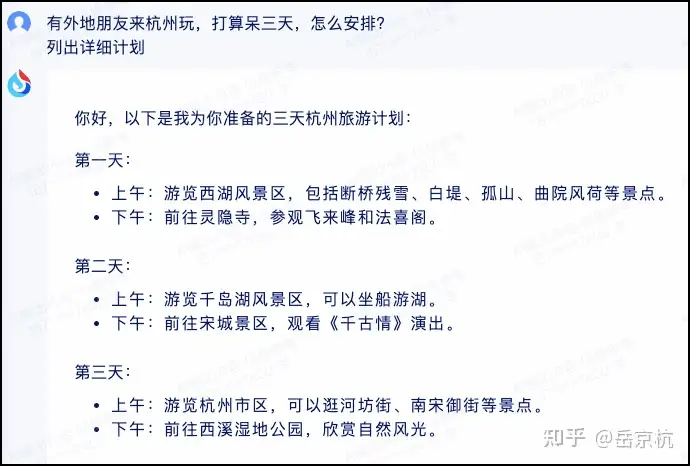

问题2:有外地朋友来杭州玩,打算呆三天,怎么安排?列出详细计划。

讯飞星火 讯飞星火回答的还可以,GPT3.5更加详细,中间午饭都给安排了,因为篇幅过长,就不贴GPT3.5的回答了,讯飞还有进步空间。

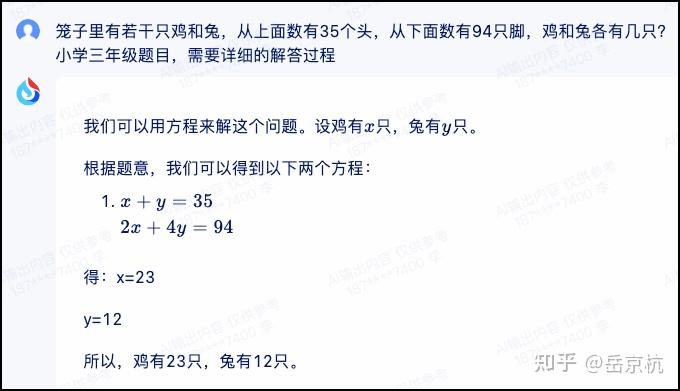

问题3:鸡兔同笼。

讯飞星火 ChatGPT3.5 都解出来了,GPT3.5更加详细,讯飞星火还有进步空间。

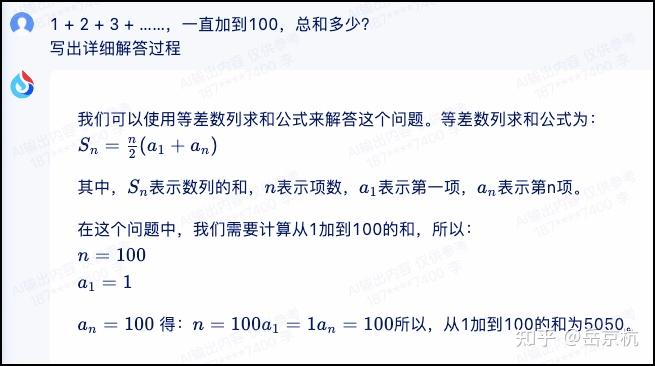

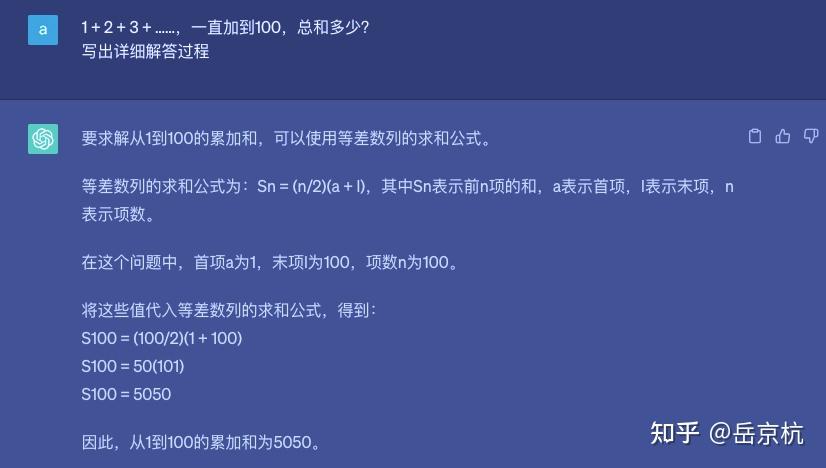

问题4:等差数列求和。

讯飞星火 ChatGPT3.5 这个问题都解出来了,GPT3.5稍微好一些。

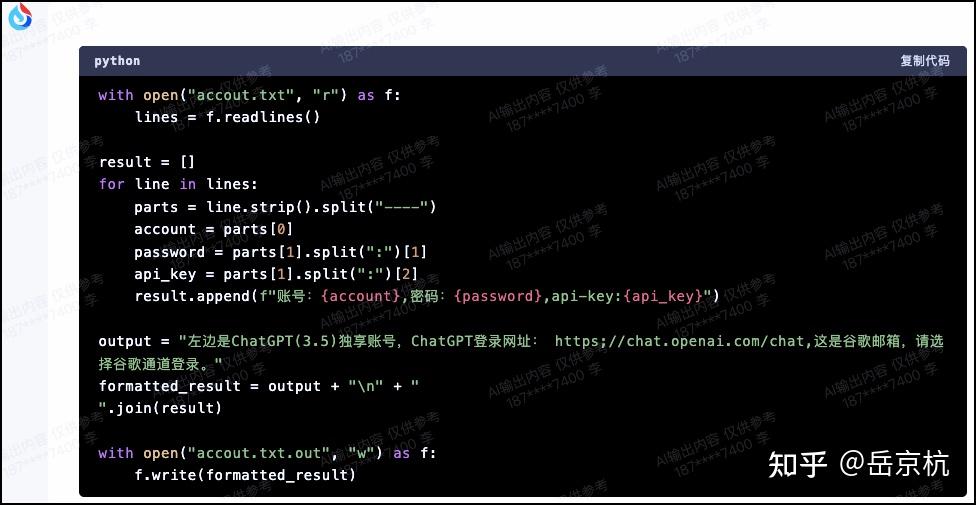

问题5:代码能力。

讯飞星火 ChatGPT3.5 ChatGPT3.5完美实现了需求,讯飞星火有bug,但是bug基础代码上,稍加修改就能得到正常代码。同样的问题,我也问了文心一言和ChatGLM,很遗憾,两家都拒绝回答。作为国内大模型,讯飞星火能做到这个程度已经不错了。

文心一言 ChatGLM 另外我找到一张图,讯飞星火宣布在8月15日实现代码能力突破,10月24日全面对标ChatGPT,希望不是吹牛逼。

讯飞星火实现了各种好用的特殊任务助手功能,比如文案写作助手对从事自媒体或者体制内写作的朋友可能有帮助,数学解题助手对家里有小学初中阶段的朋友大有帮助。

目前讯飞星火大模型对国内用户免费,感兴趣的读者可以注册一个试试,点击一下即可注册:

目前注册分两步,第一次填入手机和验证码即可:

第二次需要提供的信息多一些,包括姓名(可以不是真名)、手机号、公司名称(从下拉菜单中选择,否则不容易通过)、岗位等信息:

注册成功后,大约五六个小时后就能通过审批,之后就可以通过讯飞星火的网站(就是上面的注册链接)或者APP(安卓和苹果手机都有)体验他家大模型。

发布于 2023-07-19 09:15・IP 属地浙江查看全文>>

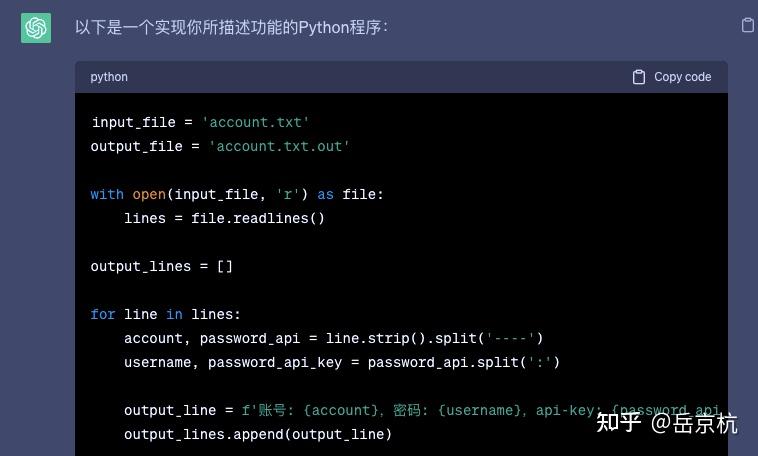

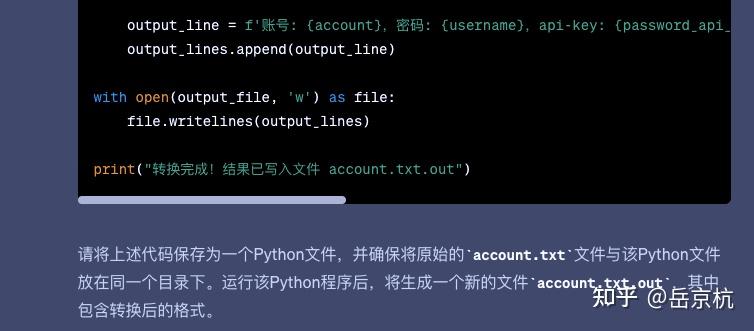

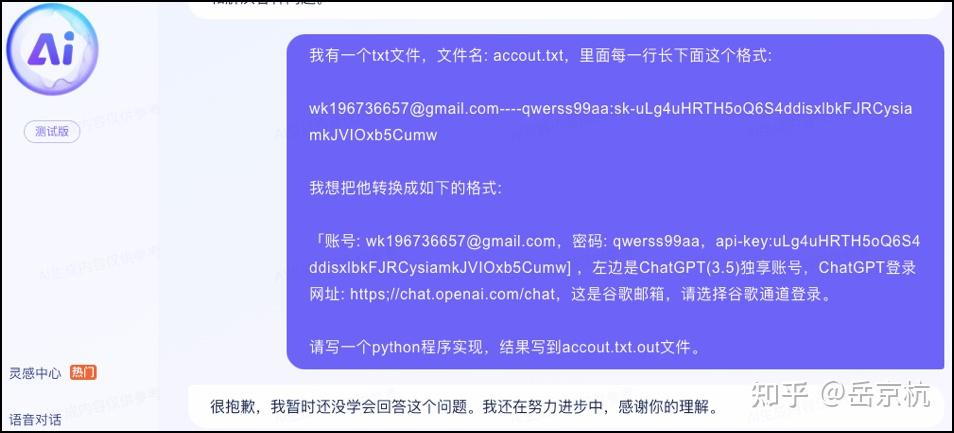

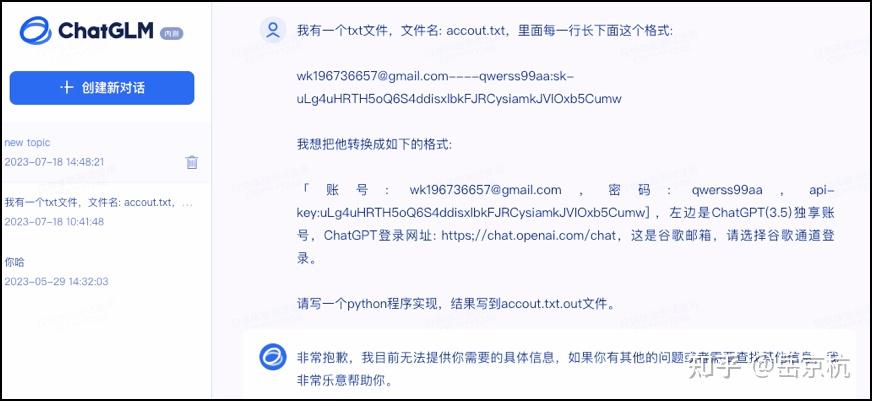

岳京杭 - 0 个点赞 👍

大模型的技术壁垒目前看来主要在如何获得更强的能力。

这些能力的获得有点类似用什么原料经过什么养调整工艺,这些东西是需要一定经验和实验积累的。

这块的积累没看到个大家公布,所以不太容易判断是否有积累出技术壁垒。

换一句话说也就是这种东西更看重的是如何做好工艺的综合管理,和实验设计。

发布于 2023-07-19 08:51・IP 属地上海查看全文>>

远洋之帆