网友反映遮挡摄像头仍能解锁 iPhone,苹果客服称「解锁是通过深感摄像头」,这是什么原理?如何理解?

- 231 个点赞 👍

查看全文>>

Ye Han - 214 个点赞 👍

查看全文>>

西子奈 - 208 个点赞 👍

查看全文>>

Sarcasm - 101 个点赞 👍

大意了大意了

本来是想着黑apple一把,好为了我的新机上市

没想到…好像是…反而给apple做了一次免费营销

市场部的儿子们等着,MCN的孙子们等着,你看你们出的啥馊主意!

——————

Tim Cook:在中国双十一期间,一股来自东方的神秘力量突然让苹果手机在华销量突破了一个新高…

发布于 2025-11-07 08:42・重庆・包含AI生成内容

发布于 2025-11-07 08:42・重庆・包含AI生成内容查看全文>>

贾不妙2025 - 79 个点赞 👍

简单说:人脸太容易复制了,指纹也太容易复制了!

比如,通过你的朋友圈照片、或者你不注意时的一张街拍/偷拍照,是不是直接就能得到你的面容照片了?然后再通过Ai,眨眼张嘴……什么都给你弄出来了。

如果你的门锁只识别影像,诈骗犯把你的照片显示出来往摄像头前一凑,是不是就会被骗了?

类似的,你家装了个指纹锁,我想偷偷进你家——而你的指纹锁居然也是摄像头!

那么,我是不是就可以从门把手上提取你的指纹?

然后,把提取的指纹打印到一张纸上、或者蚀刻成手指模型,往你指纹锁上面一按,门开了——你怕不怕?

幸好,业界没这么傻(当然,或许有一些厂商的确这么傻……

他们是怎么做的呢?

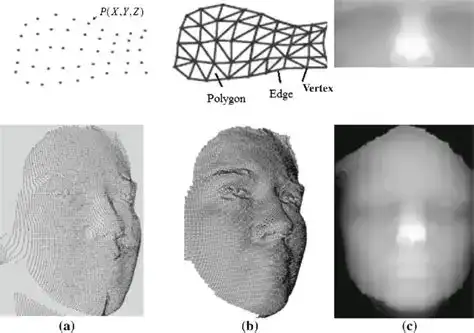

1、针对人脸容易复制的问题,他们使用“红外线相机”直接获取你的面容点云:

如此一来,想要骗过摄像头,一张照片或者手机屏幕显然就不行了——你起码得做一个石膏人头模型。

当然,这样其实仍然只是抬高了门槛。更有效的做法是,不仅要求吻合你的面容的3D点云,还要求它会动。

2、针对指纹容易复制的问题,业界普遍采用了“活体检测”技术

比如,光学识别不够安全,那就利用电容感应原理:普通的硅胶没有导电性或者导电性和生物机体相差甚远,那自然就无法识别。

再比如,通过射频信号检测真皮层的反射特性,自然就能识别是不是人体。

还有,通过光线照射、探测机体中的血液流动,假手指没有血液,自然也无法蒙混过关。

综上,如果你的手机/门锁“遮挡摄像头后仍能解锁”,那你反而可以放心了,因为它显然使用了深度摄像头技术。相反,如果你的手机/门锁在遮挡其他传感器、仅留摄像头时仍可解锁,那么你最好拿自己的照片试验一下,当心它不够安全。

还没有人送礼物,鼓励一下作者吧查看全文>>

invalid s - 76 个点赞 👍

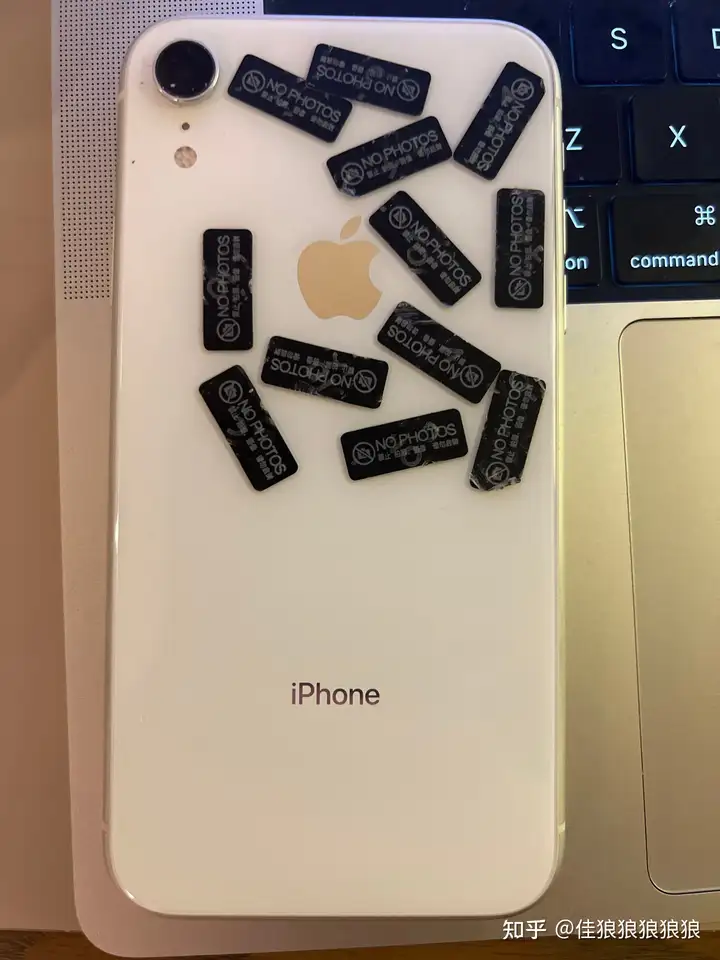

这个我熟,之前在涉密企业工作的时候,手机摄像头和充电口都要贴签,用来防止泄密,当然还有出公司要过x光之类的。总之每天早上都要把手机给前台,前台会小心翼翼的把摄像头贴上签(后来换pro后面三颗摄像头每个都要贴,超麻烦hhhh)当然也包括前置摄像头。前台会对着光,确保只贴到摄像头部分,这样就不会干扰Face ID传感器,这样解锁都不受任何影响。

找不到正面照片了这里有一个背面的,可以看到前置摄像头部分被贴了签,而且可以正常使用。

这台手机现在还留着,之前最多的时候后面都贴满了(因为每天都要贴,撕下来就顺手贴后面了)现在都掉得没剩几个了。

也算是挺好的回忆

查看全文>>

佳狼狼狼狼狼 - 40 个点赞 👍

这事情有那么复杂吗,直说了iPhone解锁是正中间偏旁边的一个摄像头,不是正中间那个。

不是说遮挡摄像头可解锁iPhone,而是仅遮挡正中间的摄像头可解锁iPhone。这种操作感觉就像故意造个大新闻,因为单纯遮挡正中间摄像头不确保不遮挡到旁边的faceid摄像头,这需要刻意的操作才能实现,正常情况下,两者都能遮住,好吗?

如果你把faceid的摄像头遮了一样不能解锁,而那个摄像头也是前置的,也在刘海的位置,只不过不在正中间,稍微偏旁边而已。

查看全文>>

pansz - 28 个点赞 👍

啊……这……

这个问题不是在 2017 年就有答案了吗?

不过非数码产品爱好者确实也不会知道这个“果子早就公布过的技术”:

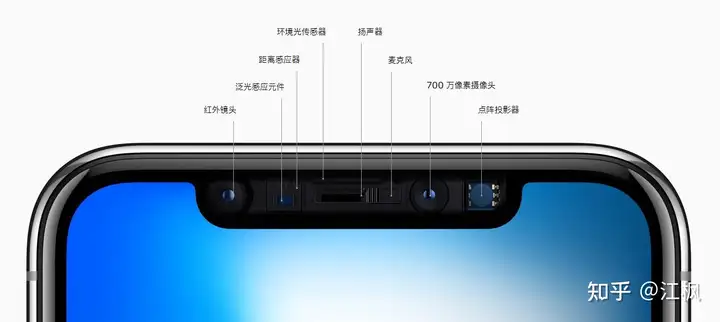

果子从 2017 年的 iPhone X 开始采用刘海屏设计,在这个刘海里有〔红外镜头、泛光感应元件、距离感应器、环境光传感器、扬声器、麦克风、700万像素摄像头、点阵投影器〕,主要就是这 8 个元器件。

我们也可以把苹果的 Face ID 理解为一套〔系统〕,由这些元器件组成 Face ID 的物理基础。

苹果在 iPhone X 的发布会上演示过 Face ID 的工作原理,也谈到了 A11 神经网络引擎

- 点阵投影仪投射 30000 多个点在人脸上;

- 红外镜头和泛光感应元件则可以通过深度摄像头实现人眼瞳孔的特征定位;

- AI 芯片 A11 的深度学习则用于估算人眼视线方向;

- 系统将接收的数据进行 3D 建模。

这套“流程”没有那个 700 万像素摄像头参与。

苹果为 A11 搭载了神经网络引擎,它具备深度学习能力,可以对用户面部的一些变化(长胡子、戴眼镜等)进行动态跟踪并实现自适应识别,这样就可以让人脸识别有更强的适应性。

到了 iPhone 12 这一代,搭载 A14 仿生芯片

后来苹果把“刘海”缩小,再之后又搞了个〔灵动岛

从最初的〔刘海屏〕开始,到 iPhone 13 那一代,苹果一直在缩小刘海的面积,然后到了 iPhone 14 Pro / Max 用了支持灵动岛的 “药丸屏

其实开孔方式是「圆形 + 药丸开孔」:

用特殊方法让两处挖孔中间的屏幕显示颜色〔网图 侵删〕 圆形开孔是前置摄像头的位置,药丸开孔是一部分 Face ID 组件的位置,主要是点阵投影、红外传感器。

挡住摄像头,但不挡住“Face ID 组件”当然可以解锁啦~

(只不过苹果把这两个开孔在日常显示时用黑色连接成了一个 “大药丸”。中间连接屏幕部分,也会被用于显示隐私指示器 ~目前带刘海的 iPhone 会显示在右上角。)

所以苹果现在是把最初〔由 8 个元器件组成的刘海〕里的一部分元器件放在了屏幕下方,但是……点阵投影、红外传感器、前摄,目前没办法都放在屏幕下方,只能采用“药丸 /双”挖孔方案。

还没有人送礼物,鼓励一下作者吧查看全文>>

江枫 - 16 个点赞 👍

我想说这东西现在早就是烂大街的技术了……一个双目结构光摄像头

原理的话,先说红外,其实生活中很常见了,跟有时候科技馆见到的远红外热感不是一回事,它就是一个只对特定频率红外光敏感的摄像头,再配合一个红外光补光器

所谓结构光,其实就是在红外这一套的基础上,在补光灯上加个特别的罩子,让它打出去的是均匀的斑点或者条纹,如果它投射到平面上那仍然是均匀分布,但如果投射到不同深度的平面上,点之间的间距会随着深度变化,经过处理就能得到深度信息。

基于深度或RGB/红外双目摄像头的活体方案也是非常常见的,一般来说仅仅是红外就足够防御低级的照片翻拍攻击了,因为照片在红外光下反光的亮度跟真人并不一样;再加上深度信息,那么低级的攻击手段就难以奏效了。这种方案中,用于人脸比对的要么是RGB要么是红外亮度图,深度图的精度其实比较低,主要只起活体检测

这种活体方案并不是100%安全的,最容易攻击成功的就是3D头模

查看全文>>

灵剑