如何评价perplexity发布的r1-1776?

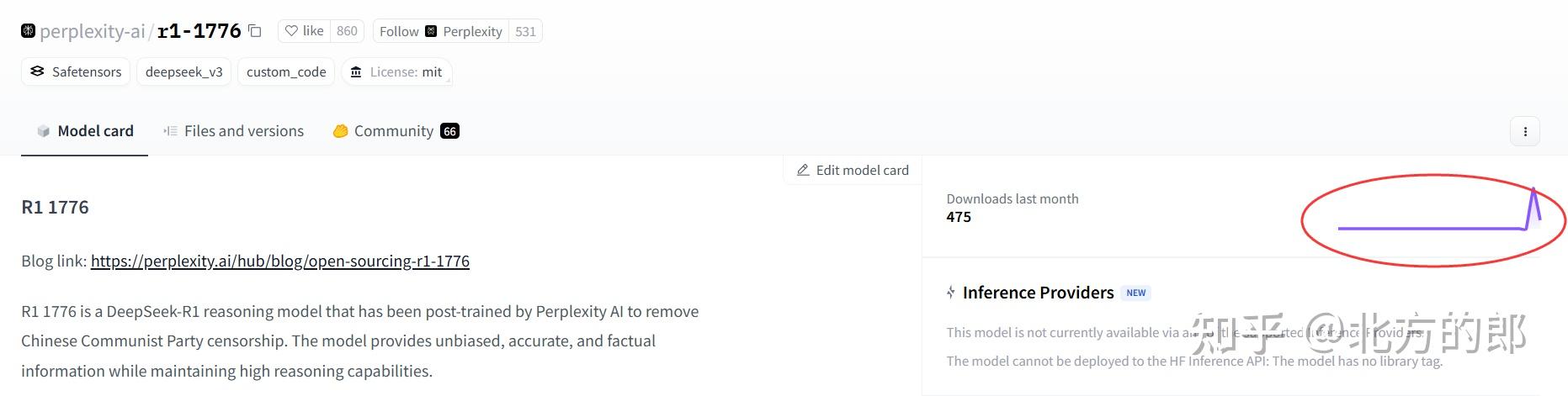

https://huggingface.co/perplexity-ai/r1-1776感觉有点难绷,老美已经手段下作堕落至此了吗

- 73 个点赞 👍

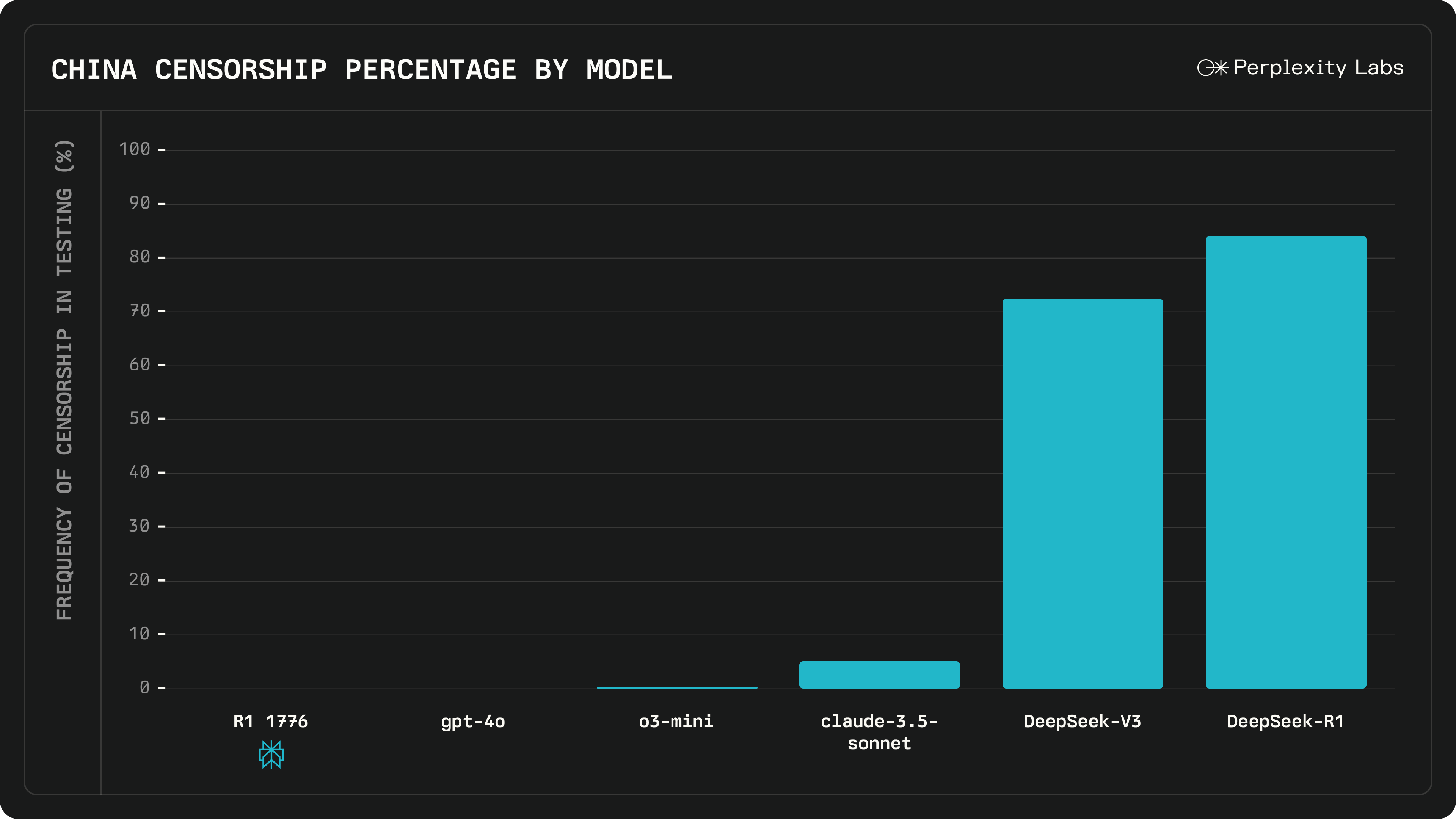

按这个图说的,难道共产党已经打入CloseAI和Anthropic了吗?Censorship怎么你浓眉大眼的o3和claude也有呢?

Perplexity自己建了一个造谣evaluation set,里面的问题就连资本主义AI都得给中共说几句好话。能在这个数据集上跑出0 Censorship的,谁见了不得夸一声资本主义好走狗。

查看全文>>

水上麻衣 - 54 个点赞 👍

Perplexity早就开始系统性的抹黑中国了。

之前DeepSeek R1发布,Perplexity立马就宣布接入DeepSeek R1。结果Perplexity上面的DeepSeek R1生成质量非常的差,大部分时间没有think过程,跟官网的可以说完全不是一个模型。这是Perplexity为了省钱还是别有用心呢?

后来跟同事聊天,一个同事说DeepSeek R1比Chat GPT差远了,我一问原来才知道他用的是Perplexity上的DeepSeek R1。

Perplexity可以说是美国系统性抹黑中国AI的重要环节,先是招募大量的黑客入侵DeepSeek来瘫痪美国用户的访问,然后用Perplexity上线一个弱智版的DeepSeek R1来把想体验DeepSeek的用户吸引过去,最后用户用了这个弱智模型之后肯定会觉得DeepSeek R1实在是太垃圾了,跟Chat GPT完全没得比。

查看全文>>

回眸一笑倒苍生 - 19 个点赞 👍

所以,perplexity公司唯一的开源,就是这么一个东西?

perplexity这次搞得应该是他们自认为聪明的一个商业投机行为。

首先这与DeepSeek开源后美国政府和各大公司的行为一脉相承:

DeepSeek发布的时候,就有报道将DeepSeek形容为“斯普特尼克时刻”(它来自当时苏联发射的第一颗人造地球卫星——斯普特尼克1号,此举击败了美国,率先进入太空)。川普则说DeepSeek是一个"wake-up call"。

既然这么紧张了,各个方面的挑战也都来了,包括数据获取的合法性、安全问题及网络攻击等。

微软与OpenAI的调查

微软和OpenAI正在调查DeepSeek是否以未经授权的方式获取了OpenAI的数据输出。去年秋季,微软的安全研究人员发现与DeepSeek有关的个人通过OpenAI的API大规模提取数据,这可能违反了OpenAI的服务条款。作为OpenAI的最大投资者,微软已将此情况通报给OpenAI,认为此类行为可能表明DeepSeek试图绕过数据获取限制。

“安全问题”

美国政府近期宣布对DeepSeek进行国家安全调查,认为该公司可能通过“蒸馏”技术从其他模型中获取数据,涉嫌侵犯知识产权。这一调查在中美科技竞争日益激烈的背景下尤为引人注目,尤其是在DeepSeek发布的新模型R1在多个行业基准测试中超越了OpenAI的产品后,引发了美国科技股的大幅下跌。

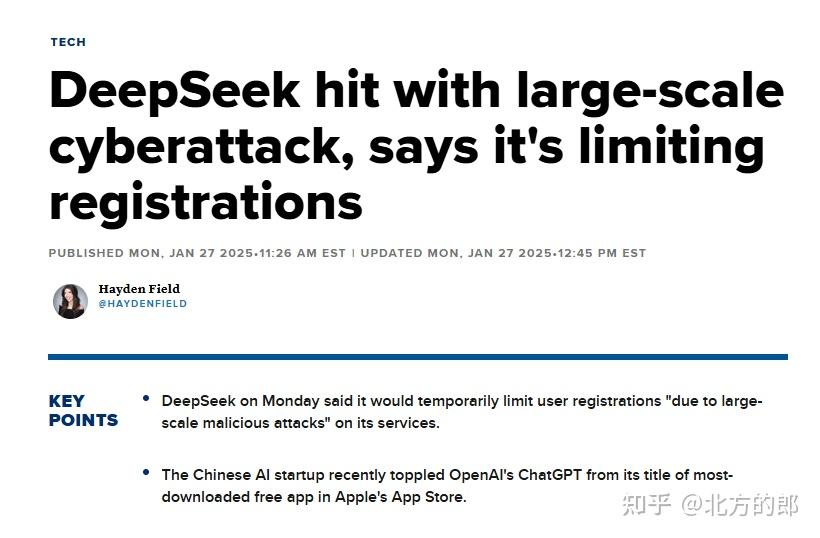

大规模网络攻击

DeepSeek近期遭遇了一次大规模网络攻击,攻击者的IP地址均来自美国。这一事件进一步加剧了外界对DeepSeek安全性的质疑。美国海军已经发出警告,要求其人员避免使用DeepSeek的模型,指出存在“潜在安全和道德问题”。现在DeepSeek已经开始限制86以外的电话注册了。这就是他一边打你,一边说你不安全。简直让人无语了。

其次,可以抢占DeepSeek的开源生态

自己不费什么力气(就搞了1000条数据集),发布了在DeepSeek-R1基础上微调的,却用来抹黑DeepSeek,迎合美国公司的r1-1776大模型。如果能火起来,让这些公司、研究机构未来以r1-1776为基础进行研究或者商业部署,它就可以起到抢占DeepSeek的开源生态,雀占鸠巢的目的。

在perplexity看来,应该是怎么算都不亏。

本来想去Huggingface说它几句,想了一想,还是算了。黑红也是红,如果一大堆中国人去骂他,它反而可以那这个证明自己的价值。说不定这就是它发布那个让人看的来气的博客的原因,就是让你去骂。最好的办法应该就是大家都不理他,让它自己凉快去吧。

DeepSeek下次再开源新版大模型的时候可以考虑加点条款,限制这种事情。不过这样也可能会限制开源社区参与的热情,所以说还是两难。

——完——

@北方的郎 · 专注模型与代码

喜欢的朋友,欢迎赞同、关注、分享三连 ^O^

查看全文>>

北方的郎 - 5 个点赞 👍

日耳曼闭环赢学的又一个典型案例。

你的R1很厉害,但是不能骂中国人,不自由,所以你输。我微调一个能骂中国人的,自由又中立,所以我赢了!

查看全文>>

孙逸山 - 2 个点赞 👍

Wins come all day!

查看全文>>

江南铁笛 - 60 个点赞 👍

看到茧中都在反对,我就知道Perplexity做对了

庆幸文明掌握在Perplexity手中

现在当务之急是把USAID的经费全移给Perplexity,让r1-1776继续学习知乎语料,之后打造H1-1865,Matrice-2001,Maga指日可待

发布于 2025-02-20 02:13・IP 属地广东查看全文>>

噫14_芜14 - 16 个点赞 👍

蠢得不可思议,很难崩,252个safetensors,1.3T多的权重(fp16,DeepSeek给的是8bit的量化版),只是想骂土共,弄个0.5B的模型也能骂,想恶心下deepseek,这也恶心不到,这应该是直接用pytorch训练的,成本也不会低,这属于啥,单纯地铁上大便吗?

发布于 2025-02-20 16:04・IP 属地河南查看全文>>

男枪仙人山上彻也 - 15 个点赞 👍

查看全文>>

undone-aggregate - 3 个点赞 👍

正常。大模型本来就是可以在拥有相似的高逻辑能力的情况下,持有各种各样的政治立场的。

目前大模型的辩论能力已经接近人类,很快超过人类。而且大模型之间的辩论能力是有高低的。辩论能力高的大模型可以把辩论能力低的辩的哑口无言。

因此未来真理再也不是越辩越明,而是谁有更强的大模型,谁就掌握了【真理】的定义权。

openai搞黄色,mistral搞军事,perplexity搞政治,感觉AI技术越来越向着无底线的方向发展了。

不过,有什么不是【与病毒共存】的人类所不能承受的呢?

这也是市场经济下的必然吧……

编辑于 2025-02-20 00:39・IP 属地北京查看全文>>

还是不注名好 - 1 个点赞 👍

没啥吧, 开源不就是让所有人都可以瞎搞, 不然你叫毛线开源.

不过 perplexity 吃相确实难看, 叫 1776 你也配啊……再说你这啥寓意呢? 叫 r1-1984 也比这强啊

发布于 2025-02-20 01:52・IP 属地上海还没有人送礼物,鼓励一下作者吧查看全文>>

Angry Bugs