最新资料是:4090+382GB内存就可以运行满血DeepSeek-Coder-V3/R1模型的Q4_K_M

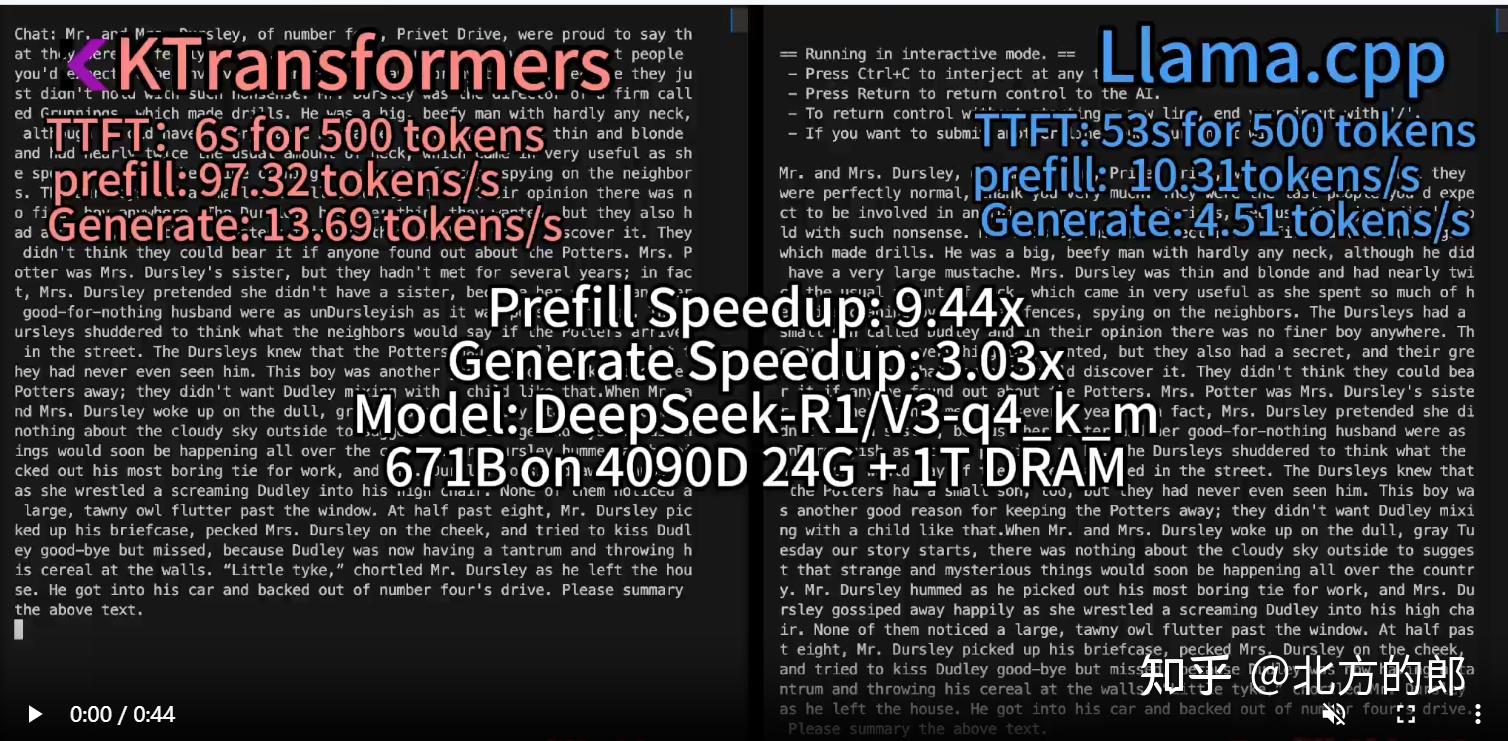

2025年2月10日,KTransformers团队(之前以本地CPU/GPU混合推理开源项目DeepSeek-V2而闻名)发布了一项新的技术成果,宣布支持DeepSeek-R1/V3模型,并展示了其在本地运行时的卓越性能。通过使用仅24GB显存和382GB内存的配置,他们成功运行了DeepSeek-Coder-V3/R1模型的Q4_K_M版本,并实现了高达3~28倍的速度提升。

GitHub:https://github.com/kvcache-ai/ktransformers

发布博客:https://github.com/kvcache-ai/ktransformers/blob/main/doc/en/DeepseekR1_V3_tutorial.md

性能亮点

- 预填充速度(Prefill Speed, tokens/s):

- KTransfermor: 单路(32核)为54.21 → 双路(64核)为74.362 → 使用Intel AMX优化的MoE内核(V0.3版)为255.26 → 选择性激活6个专家(V0.3版)为286.55。

- 相较于llama.cpp在双路配置下的10.31 tokens/s,KTransfermor实现了最高27.79倍的速度提升。

- 解码速度(Decode Speed, tokens/s):

- KTransfermor: 单路(32核)为8.73 → 双路(64核)为11.26 → 选择性激活6个专家(V0.3版)为13.69。

- 相较于llama.cpp在双路配置下的4.51 tokens/s,KTransfermor实现了最高3.03倍的速度提升。

技术优化

团队通过以下两项关键技术实现了性能飞跃:

- Intel AMX指令集加速: 针对Intel CPU的AMX指令集进行了深度优化,使计算效率远超现有的llama.cpp实现。

- 专家选择策略: 基于离线分析结果,减少了推理过程中激活的专家数量,从而显著提升了速度,同时保持输出质量不变。

版本对比

- V0.2版: 支持DeepseekV3-q4km(int4量化),需要至少14GB显存和382GB内存。

- V0.3-Preview版: 支持DeepseekV3-BF16模型,并通过在线量化适配CPU(int8)和GPU(int4)。预填充速度比V0.2版快3.45倍,比llama.cpp快27.79倍。

详见:北方的郎:突破大模型推理极限:1张4090跑满血671B的DeepSeek-V3/R1大模型!

——完——

@北方的郎 · 专注模型与代码

喜欢的朋友,欢迎赞同、关注、分享三连 ^O^