你看chatgpt4头跑的模型

那是什么数学问题,全是工程化架构的问题。

25000张A100怎么互相通讯,

重新搞个算子训练,不如研究怎么架构更好的集群,使用什么方式能够降低推理延迟。

最近meta发布了商业的Llama 2

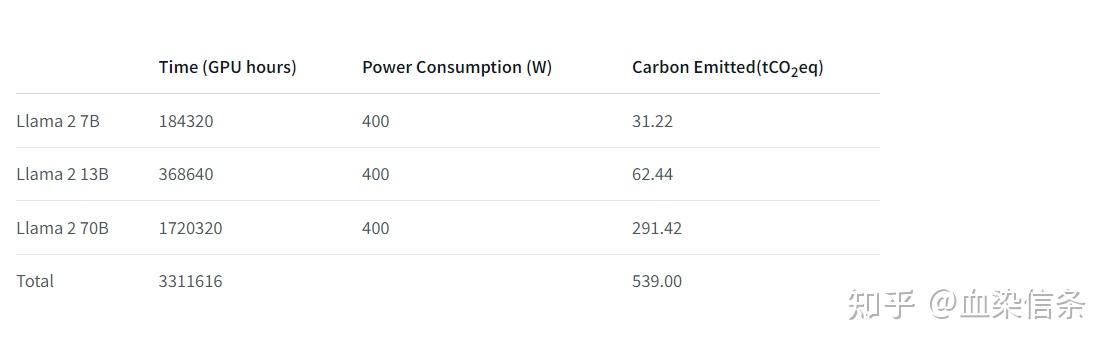

看了一下他需要的硬件参数

妈耶。总共花了331w小时,也就是一张A100要331w个小时,2w张也要160多个小时训练。

一张卡0.4度电,331w小时,就要130w度电。训练一次电费就不少钱了。

在这样一次训练上,做好业务架构,比优化算子来得更直接,很多时,解决一个性能瓶颈效果立竿见影。

编辑于 2023-07-24 09:27・IP 属地贵州